Markdown : pourquoi c'est le format pivot d'un projet IA (et comment l'adopter)

Tous les LLM produisent et consomment du Markdown nativement. Ce format est devenu le standard de fait des projets IA. Cet article explique pourquoi ce format se distingue des formats que tu utilises par défaut et comment l'intégrer dans ta méthode de travail

Résumé de l'article

Article de fond sur le format Markdown comme pivot d'un projet IA. L'article pose les fondamentaux du format, démontre pourquoi il s'impose en contexte de production assistée par l'IA, le compare aux formats challengers (Word, Google Docs, Notion, PDF, HTML), donne le cadre d'intégration dans un projet, et outille le lecteur sur les éditeurs disponibles avec un focus sur Obsidian.

Articles connexes

- "Auditer un site avec Claude Opus 4.7" — la méthode d'audit s'appuie nativement sur Markdown.

- La construction d'une knowledge base réellement utile.

Markdown : pourquoi c'est le format pivot d'un projet IA (et comment l'adopter)

Tous les LLM produisent et consomment du Markdown nativement. Ce n'est pas un hasard, c'est une convergence. Ce format, presque invisible quand on l'utilise, est devenu en quelques années le standard de fait des projets IA — et il y a de bonnes raisons à ça, qui dépassent largement la question du goût ou de l'habitude.

Quand on bascule sa méthode de travail vers une production assistée par l'IA, le choix du format n'est pas un détail d'intendance. C'est une décision structurante, qui conditionne la fluidité de la collaboration avec le modèle, la qualité des livrables produits, et la maintenabilité du projet dans le temps. Cet article explique pourquoi Markdown coche toutes les cases, ce qui le distingue des formats que tu utilises probablement par défaut, et comment l'intégrer concrètement dans tes projets.

Markdown est le format le mieux adapté à une production assistée par l'IA, pour des raisons techniques et structurelles.Sa lisibilité, sa portabilité et sa compatibilité native avec les LLM en font le format pivot d'un projet IA bien organisé.Les formats bureautiques (Word, Google Docs) restent excellents dans leur contexte d'origine, mais ils deviennent un frein dès qu'on travaille avec un LLM.Bien outillé — Obsidian en tête — Markdown devient un environnement de travail à part entière, pas juste un format de fichier.

Sommaire

- Markdown, le format que l'IA "parle nativement"

- Anatomie du format : ce qu'il faut savoir pour bien l'utiliser

- Markdown vs autres formats : le bon outil pour le bon contexte

- Comment intégrer Markdown dans un projet IA

- Les outils pour travailler le Markdown au quotidien

- Conclusion

1. Markdown, le format que l'IA "parle nativement"

Une syntaxe minimaliste née pour la lisibilité

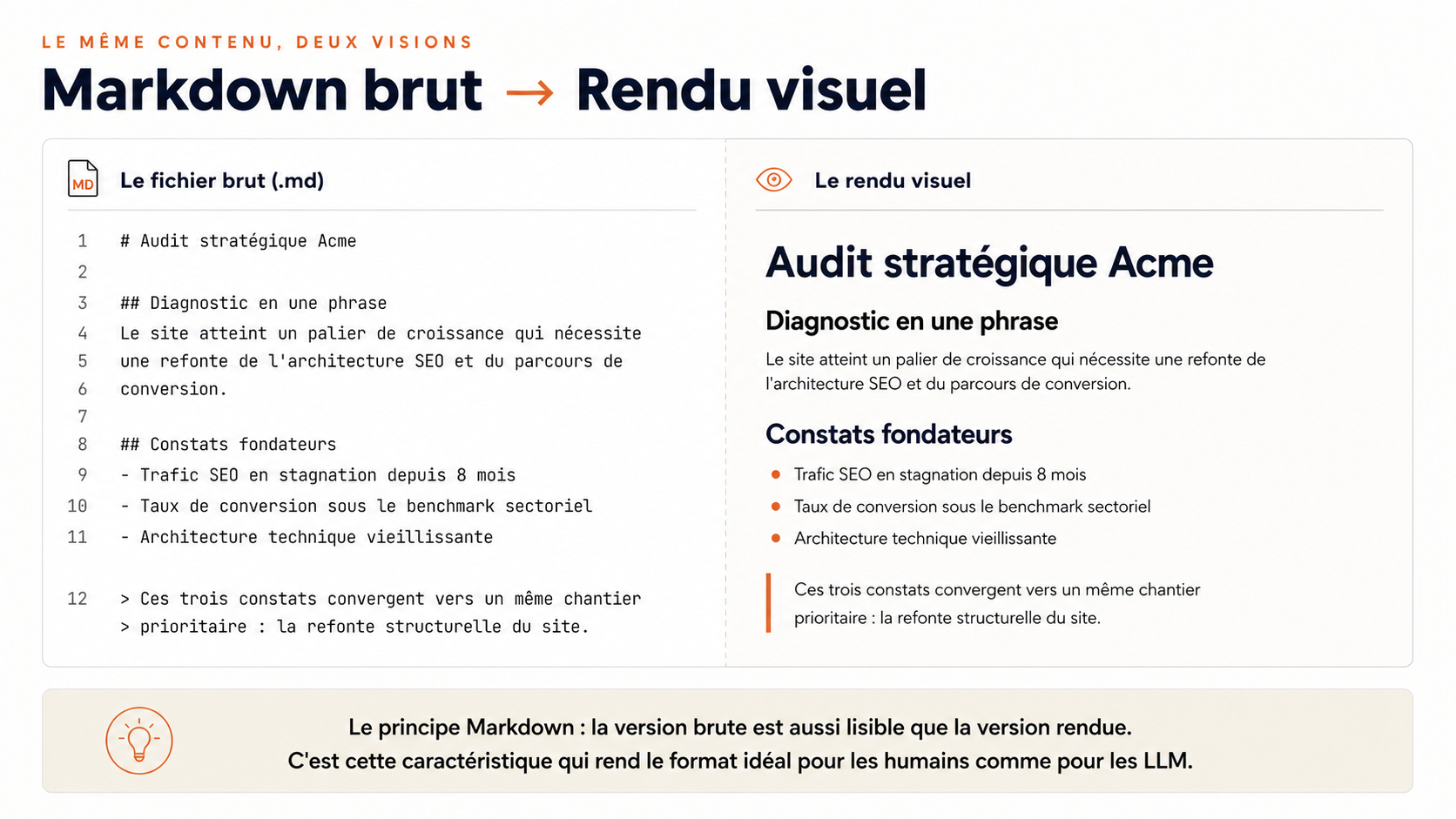

Markdown a été créé en 2004 par John Gruber, en collaboration avec Aaron Swartz. Son principe fondateur tient en une phrase : un fichier Markdown brut doit être lisible et compréhensible tel quel, même sans rendu graphique. Tu ouvres un .md dans n'importe quel éditeur de texte, et tu comprends sa structure, ses titres, ses listes, ses citations, en un coup d'œil.

C'est une caractéristique qui peut sembler anodine. Elle est en réalité décisive. Toutes les implications du format découlent de cette intention initiale : si un humain peut lire le format brut sans effort, alors une machine peut l'analyser sans ambiguïté, un outil peut le convertir sans perdre de structure, et un éditeur peut le rendre sans configuration complexe.

Le fichier .md est du texte pur. Pas de binaire, pas d'encodage propriétaire, pas de dépendance à un éditeur. Il est léger, durable, ouvrable partout. Il sera encore lisible dans vingt ans, ce que peu de formats peuvent prétendre.

Pourquoi les LLM s'y sentent chez eux

Les LLM sont entraînés sur d'énormes corpus textuels, et une part très significative de ces corpus est constituée de Markdown : documentation technique, projets GitHub, articles de blog tech, posts Stack Overflow, README de millions de projets open source. Quand un modèle reçoit du Markdown, il ne traite pas un format exotique, il retrouve un terrain qu'il connaît mieux que la moyenne.

Cette familiarité a deux conséquences directes pour la production assistée par l'IA. D'abord, les modèles produisent spontanément du Markdown quand on leur demande de structurer une réponse longue : titres, listes, blocs de code, tableaux. C'est leur format de structuration par défaut, à tel point qu'il faut leur demander explicitement d'écrire en texte brut s'ils ne doivent pas l'utiliser.

Ensuite, les LLM exploitent mieux la sémantique d'un document Markdown que celle d'un document Word ou d'une page HTML complexe. Un titre H2 n'est pas juste du texte en gras plus gros, c'est un marqueur sémantique de section qui aide le modèle à comprendre la hiérarchie de l'information. Une liste à puces n'est pas une mise en forme, c'est une énumération que le modèle reconnaît comme telle. La structure formelle du Markdown rejoint la structure logique du contenu, et c'est exactement ce dont un LLM a besoin pour bien lire et bien produire.

Un standard de fait dans l'écosystème IA

Tous les grands modèles produisent du Markdown par défaut dans leurs interfaces : Claude, ChatGPT, Gemini, Mistral. Tous les outils de la chaîne IA — knowledge bases, projets, systèmes de RAG, frameworks de fine-tuning — consomment du Markdown sans friction.

L'industrie a même formalisé certains usages spécifiques autour de fichiers Markdown structurés : README.md pour la documentation des projets, CLAUDE.md ou AGENTS.md pour briefer les agents IA sur un repository, SKILL.md pour décrire des compétences réutilisables. Ces conventions ne sont pas des coïncidences : elles confirment que Markdown est devenu le format pivot autour duquel s'organisent les méthodes de travail avec l'IA.

Quand on adopte Markdown pour ses projets, on n'adopte pas un format technique parmi d'autres. On s'aligne sur l'écosystème dans lequel l'IA elle-même évolue.

2. Anatomie du format : ce qu'il faut savoir pour bien l'utiliser

La syntaxe essentielle en un coup d'œil

La force de Markdown, c'est qu'on peut produire un document structuré complet avec une dizaine de symboles. Voici les éléments fondamentaux :

| Élément | Syntaxe Markdown | Rendu |

|---|---|---|

| Titre niveau 1 | # Mon titre | Grand titre |

| Titre niveau 2 | ## Mon sous-titre | Sous-titre |

| Gras | **texte** | texte |

| Italique | *texte* | texte |

| Liste à puces | - élément | • élément |

| Liste numérotée | 1. élément | 1. élément |

| Lien | [libellé](https://url) | libellé |

| Citation | > citation | citation en bloc |

| Code inline | `code` | code |

Voilà : avec ça, tu sais déjà écrire 90 % de ce dont tu as besoin. La courbe d'apprentissage est si plate qu'on l'enjambe en dix minutes.

Ce que Markdown sait faire de plus

Au-delà des bases, le format gère élégamment plusieurs éléments précieux dans un contexte professionnel :

Les tableaux, qui restent étonnamment lisibles en brut grâce à un alignement par pipes (|) et tirets. Un tableau Markdown se relit sans rendu, ce qui n'est vrai d'aucun autre format de document.

Les blocs de code typés par langage, où il suffit d'indiquer le langage après les triples backticks (```python) pour obtenir une coloration syntaxique adaptée. Précieux pour la production technique, et exploité directement par les LLM qui adaptent leur lecture en conséquence.

Les listes de tâches (- [ ] pour une case à cocher vide, - [x] pour cochée), qui transforment un Markdown en outil de suivi opérationnel léger.

Les notes de bas de page, le strikethrough, les liens automatiques : autant de petites finitions qui rendent le format adapté à de la production éditoriale sérieuse.

Le frontmatter YAML : c'est probablement la fonctionnalité la plus sous-estimée, et l'une des plus utiles dans une logique de projet IA. Il s'agit d'un encart de métadonnées placé en tête de fichier, encadré par trois tirets :

---

titre: Audit stratégique du site Acme

client: Acme

date: 2026-04-15

statut: en révision

tags: [audit, seo, growth]

---Ces métadonnées ne s'affichent pas dans le rendu, mais elles sont exploitables par les outils qui lisent le fichier — pour filtrer, classer, requêter une base documentaire. Un projet IA bien organisé tire énormément de bénéfices de cette couche de métadonnées propres.

Les variantes à connaître (CommonMark, GFM, MDX)

Petit point de vigilance : Markdown n'est pas une norme unique. Plusieurs flavors coexistent, héritage du fait que la spécification originale de 2004 laissait de nombreuses zones grises.

CommonMark est la spécification de référence qui standardise le comportement de base, là où la spec originale était ambiguë. C'est le socle commun aujourd'hui adopté par la grande majorité des outils.

GitHub Flavored Markdown (GFM) est l'extension la plus répandue. Elle ajoute par-dessus CommonMark les tableaux, les listes de tâches, les autoliens, le strikethrough, et quelques autres éléments. C'est de fait la variante la mieux supportée partout, y compris dans les outils IA.

MDX est une extension qui permet d'inclure des composants React directement dans du Markdown. Utile dans des contextes de documentation technique avancée, mais hors sujet pour la majorité des projets.

Dans la pratique, tu n'as pas besoin de te poser de questions : écris en GFM, c'est la norme la mieux supportée, et tu seras compatible avec tous les outils que tu rencontreras.

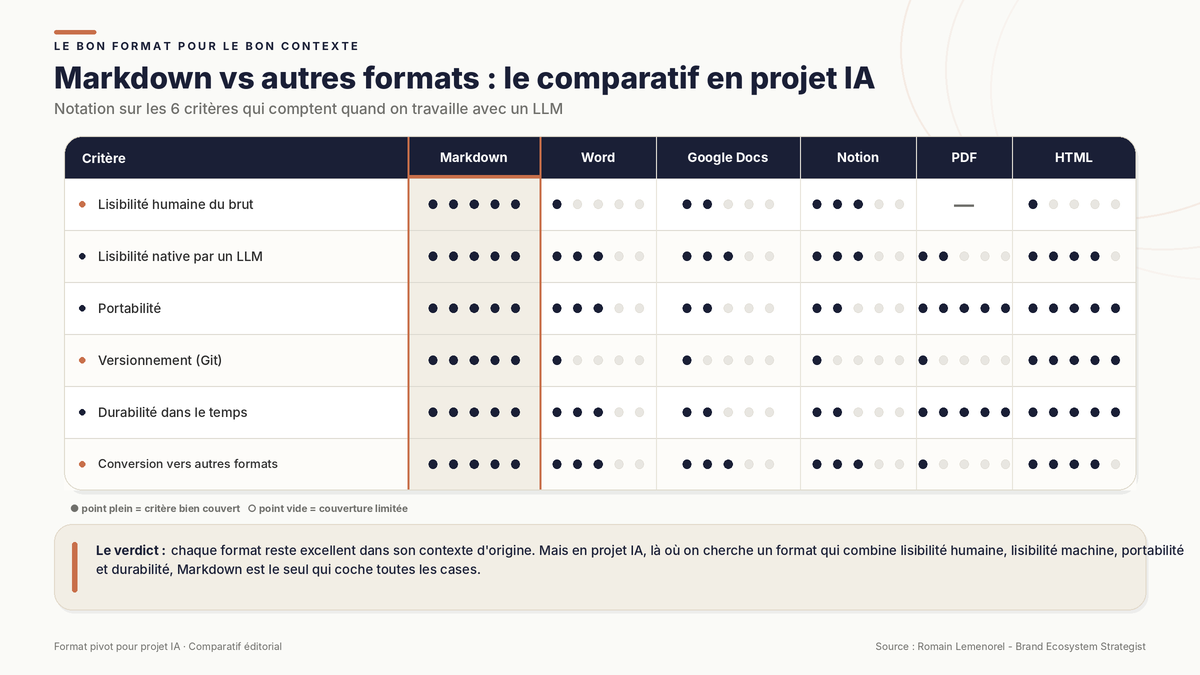

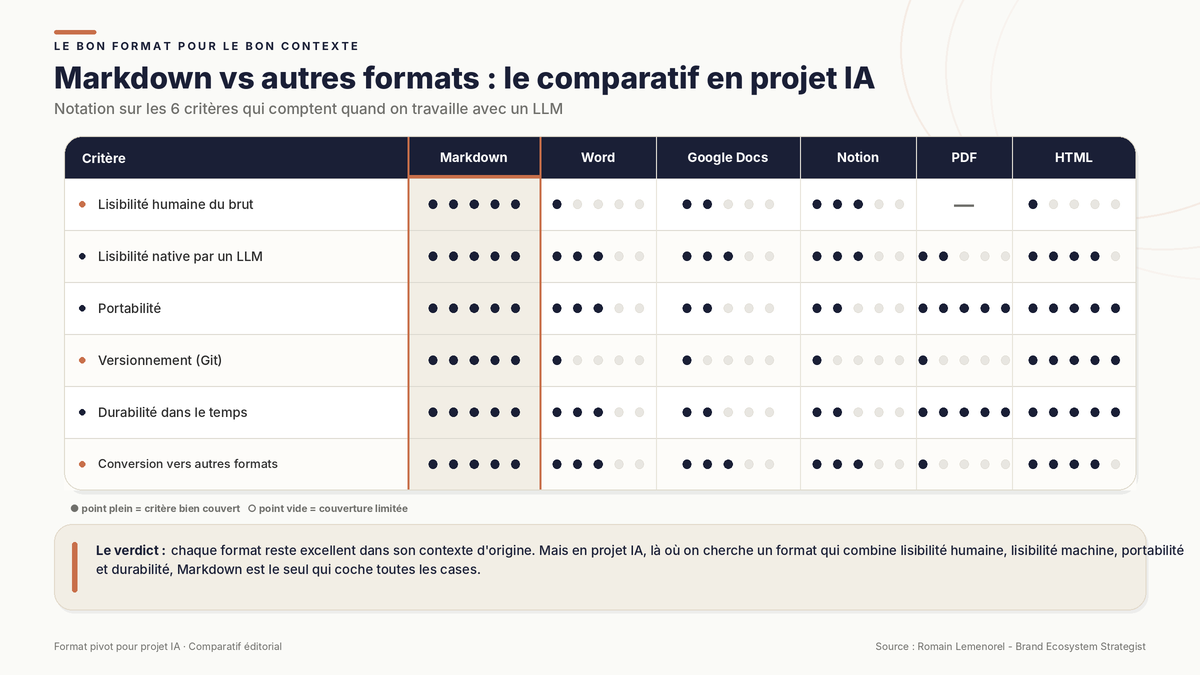

3. Markdown vs autres formats : le bon outil pour le bon contexte

Le choix d'un format dépend toujours du contexte d'usage. Word, Google Docs, Notion, PDF, HTML : chacun a sa légitimité dans son terrain d'origine. Mais quand on travaille avec un LLM au cœur de son processus, leurs caractéristiques deviennent des freins concrets. Voici pourquoi.

Word et les formats bureautiques : conçus pour l'œil, pas pour la machine

Word reste un excellent format pour ce pour quoi il a été conçu : produire un document mis en page destiné à être imprimé ou envoyé tel quel — un courrier officiel, un contrat, un rapport bouclé prêt à signer. Sa puissance typographique, ses outils de révision, son intégration avec l'écosystème Office en font un standard inégalé pour ces usages.

Mais en contexte IA, Word pose plusieurs problèmes structurels. Le format .docx est binaire, ce qui veut dire qu'on ne peut pas l'ouvrir et le lire dans un simple éditeur de texte. Il est lourd, opaque, et difficile à versionner correctement. Les LLM peuvent le lire, mais ils perdent souvent en finesse de structure : la mise en forme parasite la sémantique, les styles ne sont pas toujours interprétés comme des marqueurs hiérarchiques, et certains éléments visuels (encadrés, mises en page complexes) sont mal restitués au modèle.

Conséquence : Word est un format de destination, pas un format de production dans un projet IA. On peut générer un Word à partir d'un Markdown pour livrer au client. L'inverse — écrire en Word puis demander à l'IA de travailler dessus — fonctionne, mais avec une perte de qualité systématique.

Google Docs et Notion : excellents pour la collaboration, fragiles en sortie IA

Google Docs et Notion brillent sur un terrain où Markdown est plus faible : la collaboration synchrone. Plusieurs personnes qui éditent le même document en temps réel, les commentaires en marge, les suggestions, l'historique granulaire des modifications — ce sont des cas d'usage où ces outils sont supérieurs.

En contexte IA, leurs limites apparaissent à deux endroits. D'abord, la donnée vit dans le SaaS, pas dans un fichier que tu contrôles. Pour faire entrer un Google Doc dans une chaîne IA — knowledge base, projet, automatisation — il faut systématiquement passer par un export, et chaque export ajoute une couche de friction. Ensuite, les exports vers Markdown sont inégaux. Notion gère bien la structure, mais perd certaines subtilités. Google Docs vers Markdown est plus approximatif, surtout sur les listes imbriquées et les tableaux.

Conséquence : ces outils sont excellents en amont (capter, co-rédiger, valider) ou en aval (publier, partager). Mais au cœur du processus de production assistée par l'IA, ils introduisent des frictions qui finissent par coûter cher.

PDF et HTML : des formats de diffusion, pas de production

Le PDF est le format de diffusion par excellence quand le rendu doit être figé. Tu envoies un livrable au client, tu publies un rapport, tu archives un document : le PDF garantit que le rendu sera identique partout. Excellent dans ce rôle.

Mais le PDF est un mauvais format de travail. L'édition est pénible, la structure se dégrade à l'extraction, et faire travailler un LLM sur un PDF complexe demande presque toujours une étape de pré-traitement. Le format est conçu pour l'affichage, pas pour la manipulation.

HTML, de son côté, est excellent pour le web — c'est même son rôle exclusif. Mais l'écrire à la main est verbeux, fastidieux, et n'a aucun sens quand on peut écrire du Markdown qui se convertit en HTML en une commande.

Conséquence : ce sont des formats de sortie. On les génère depuis un Markdown, on n'écrit pas dedans.

Markdown : ce que les autres formats ne peuvent pas offrir

Quand on aligne Markdown face aux autres sur les critères qui comptent dans un projet IA, le constat est sans appel :

- Texte brut, donc lisible humainement même sans rendu, et exploitable nativement par n'importe quel outil.

- Versionnable nativement : Git fonctionne parfaitement avec, ce qui ouvre toutes les pratiques modernes de collaboration et d'historique.

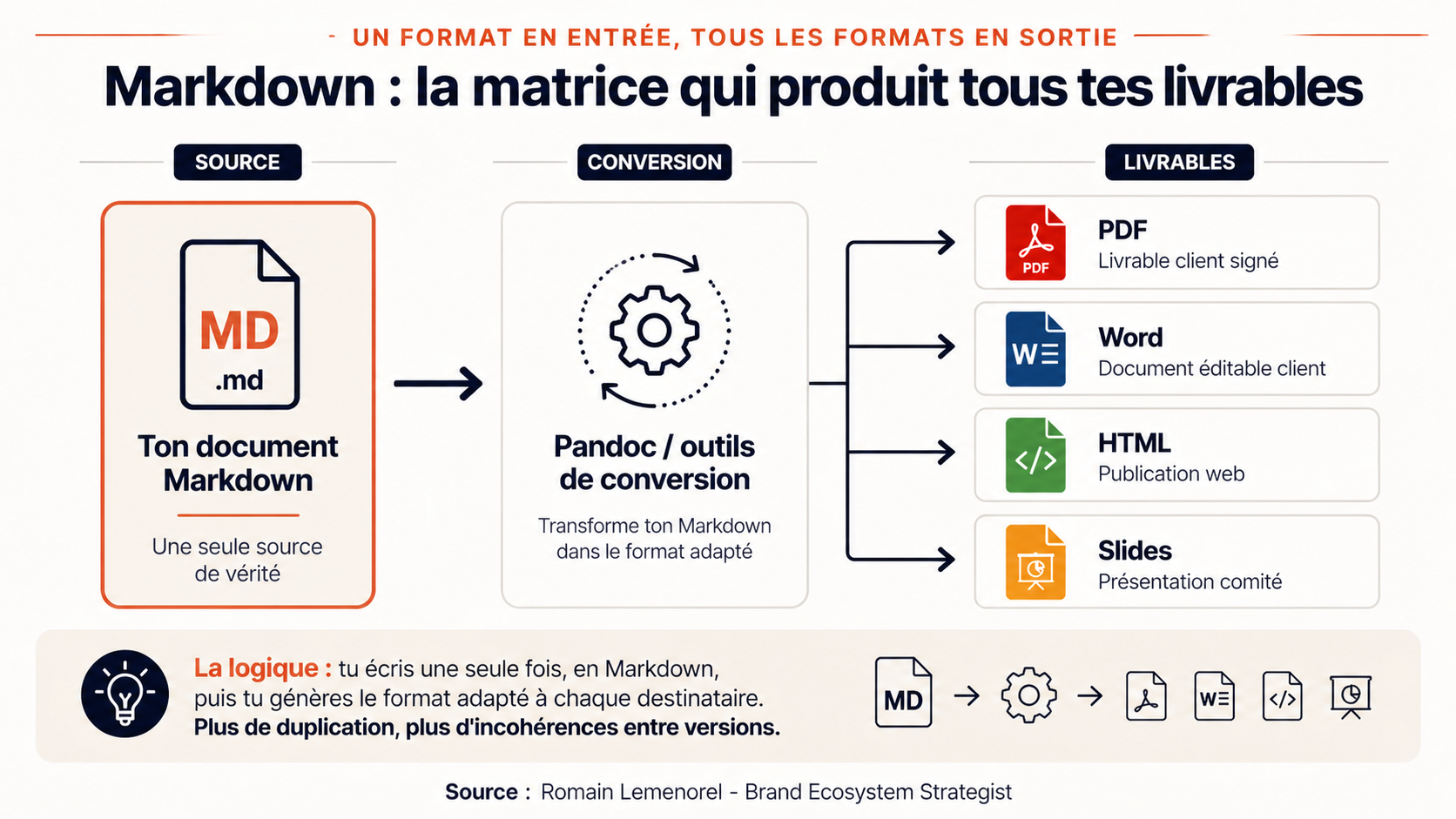

- Convertible vers tous les autres formats (Word, PDF, HTML, slides) sans perte de structure, grâce à des outils comme Pandoc.

- Pas de dépendance à un éditeur ou un SaaS : un fichier

.mdreste lisible dans vingt ans, dans n'importe quel logiciel. - Compatibilité native avec tous les LLM et tous les outils de la chaîne IA, sans étape de conversion intermédiaire.

Markdown n'est pas "meilleur" en absolu. Il est imbattable pour ce cas d'usage spécifique : la production assistée par l'IA. Et c'est précisément ce qu'on cherche.

4. Comment intégrer Markdown dans un projet IA

Adopter Markdown ne se résume pas à écrire dans un nouveau format. C'est repenser l'architecture documentaire de tes projets pour en faire un système cohérent, lisible par toi comme par l'IA, et maintenable dans le temps.

Le format de travail unique du projet

Le principe directeur tient en une phrase : tout le contenu structuré du projet vit en Markdown. La knowledge base, les briefs, les livrables, les prompts validés, les comptes rendus, les fiches client, les audits — tout. Un seul format pour produire, échanger avec l'IA, archiver, convertir.

Cette unification a un effet qu'on sous-estime au début et qu'on comprend après quelques semaines de pratique : la cohérence du format est en elle-même un gain de productivité. Plus de friction quand tu passes d'un document à l'autre, plus de gestion d'exports, plus de conversions à la volée. Tu travailles dans un seul environnement, et l'IA aussi.

C'est précisément ce choix qui structure ma méthode d'audit, détaillée dans l'article précédent : un livrable architecturé en plan maître + annexes piliers, entièrement produit en Markdown, qui peut ensuite être converti vers n'importe quel format de diffusion en fonction du besoin client.

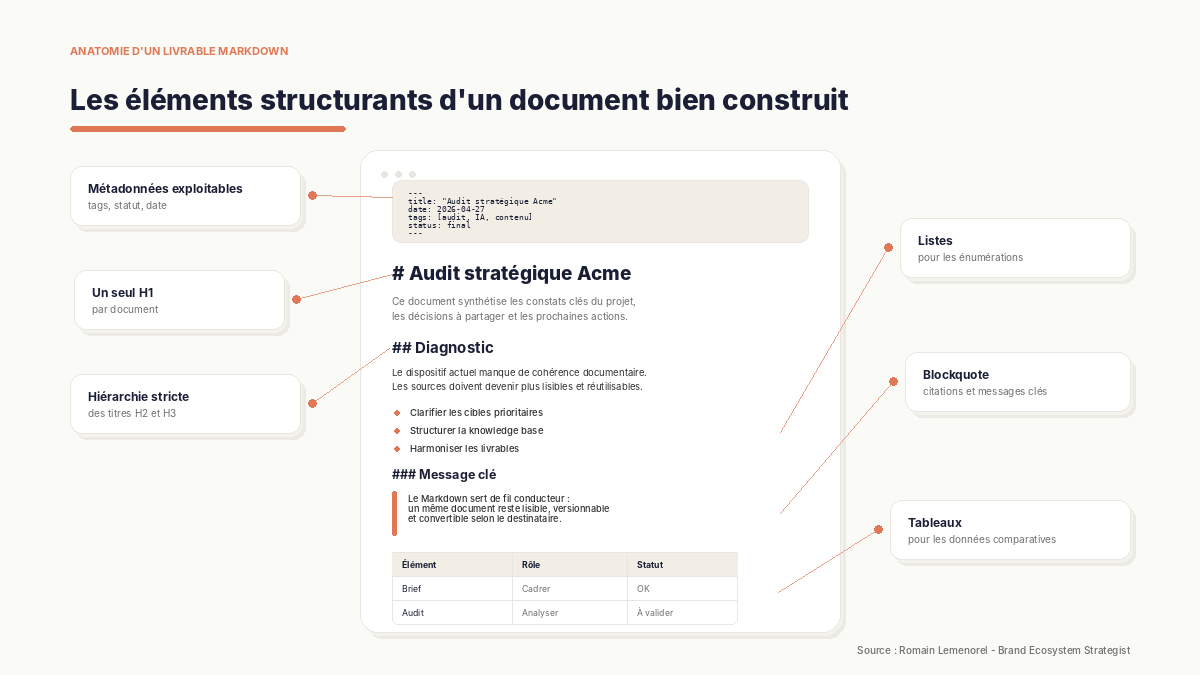

La structure type d'un livrable Markdown

Quelques principes éditoriaux font la différence entre un Markdown brouillon et un livrable propre.

Les conventions de nommage des fichiers sont la première étape. Un nom de fichier lisible, daté quand c'est pertinent, slug-friendly (sans accents, espaces remplacés par des tirets), facilite la recherche et la navigation. Un fichier nommé 2026-04-audit-acme-plan-maitre.md te dit en un coup d'œil de quoi il s'agit.

Le frontmatter YAML mérite d'être systématisé sur les documents structurants. Titre, date, tags, statut, client, version : autant de métadonnées qui permettent ensuite à des outils comme Obsidian de filtrer, classer, requêter ta base documentaire de manière fluide. C'est l'investissement le plus rentable que tu puisses faire au démarrage.

La hiérarchie des titres doit être stricte : un seul H1 par document (le titre du document lui-même), des H2 pour les sections principales, des H3 pour les sous-sections. Cette discipline sert la lecture humaine, mais elle sert encore plus la lecture par les LLM, qui s'appuient sur cette structure pour comprendre l'organisation du contenu.

L'art de l'auto-portance, enfin. Chaque section doit pouvoir être lue isolément, sans que le lecteur ait besoin de reconstituer un contexte évoqué ailleurs. C'est exactement la logique du "plan maître + annexes piliers" : chaque annexe vit en autonomie tout en s'inscrivant dans un ensemble cohérent. Cette discipline éditoriale est aussi celle qui rend tes documents les plus utiles pour l'IA : un LLM qui lit une annexe doit pouvoir la comprendre sans ambiguïté.

Les bonnes pratiques pour une lecture optimale par les LLM

Quelques conventions, simples mais structurantes, maximisent la qualité de lecture et de production par les LLM :

- Des titres explicites et sémantiquement clairs. Un H2 doit annoncer son contenu sans ambiguïté. Évite les titres "marketing" ou allusifs dans les documents de travail.

- Des phrases auto-portantes. Évite les renvois implicites du type "comme on l'a vu plus haut" qui obligent le modèle (et le lecteur humain) à reconstituer un contexte.

- Des listes pour les énumérations de plus de trois éléments, et de la prose pour le raisonnement. Ne transforme pas tout en bullet points : la prose porte mieux les nuances et les enchaînements logiques.

- Des blocs de code pour le code, des blockquote pour les citations, des tableaux pour les données comparatives. Chaque type de contenu a son marqueur sémantique. Respecte-les.

- Pas de mise en forme parasite. Le gras décoratif, l'italique d'emphase abusive, les majuscules à tout-va dégradent le signal envoyé au modèle.

- Des métadonnées explicites quand c'est utile : frontmatter, balises de section, tags. Ce sont autant de prises supplémentaires pour le LLM qui doit naviguer dans ta base documentaire.

Ces règles n'ont rien de contraignant. Elles convergent simplement avec ce qui fait un bon document tout court : structuré, clair, autosuffisant.

Les ponts vers les formats de diffusion finale

Markdown est la matrice de production, ce n'est pas le format final pour le client. La conversion vers les formats de diffusion se fait au moment opportun, en fonction du livrable attendu.

Pandoc est le couteau suisse de cette conversion. Cet outil en ligne de commande convertit du Markdown vers à peu près tous les formats existants : PDF, Word, HTML, ePub, slides Beamer, et bien d'autres. Une seule commande, un seul script, et ton Markdown devient un livrable prêt à envoyer.

Pour les présentations clients, la transformation d'un Markdown en deck de slides est un cas particulier qui mérite son propre traitement. C'est un sujet à part entière — équilibre texte/visuel, hiérarchie de l'information, narration — auquel je consacrerai un article dédié.

5. Les outils pour travailler le Markdown au quotidien

Le panorama rapide des outils disponibles

L'écosystème Markdown est vaste, et chaque famille d'outils a sa logique. Une cartographie rapide pour situer le lecteur :

Les éditeurs de texte légers comme VS Code, Sublime Text ou BBEdit sont parfaits si tu as déjà un environnement de développement. Ils gèrent Markdown nativement, avec coloration syntaxique et prévisualisation. Polyvalents, fiables, mais peu spécialisés.

Les éditeurs Markdown dédiés comme Typora, iA Writer ou MarkText sont centrés sur l'écriture. Rendu en temps réel, interface épurée, expérience fluide. Excellents pour la rédaction pure, mais limités quand le projet devient une base documentaire à part entière.

Les éditeurs hybrides note-taking comme Obsidian, Logseq ou Bear vont plus loin. Ils ne traitent pas le fichier Markdown comme un objet isolé, ils proposent un véritable environnement de travail : organisation en vault, liens entre notes, tags, plugins, vues spécifiques.

Les plateformes en ligne comme HackMD, StackEdit ou Dillinger sont pratiques pour collaborer ponctuellement ou éditer un fichier sans installer d'outil.

Pour un projet IA structuré, ce sont les éditeurs hybrides qui font la différence. Et parmi eux, Obsidian sort du lot.

Obsidian : pourquoi c'est mon environnement de référence

Obsidian coche plusieurs cases que les autres outils manquent quand on travaille en projet IA.

Le fichier reste roi. Un vault Obsidian, c'est ni plus ni moins qu'un dossier de fichiers .md standards sur ta machine. Aucun format propriétaire, aucune base de données opaque. Si tu désinstalles Obsidian demain, tes fichiers restent intacts, lisibles dans n'importe quel autre outil. Cette indépendance vis-à-vis du logiciel est précieuse — c'est l'inverse exact de la logique SaaS où ta donnée est captive.

Local-first. Les fichiers vivent sur ta machine, pas sur les serveurs d'une plateforme. Quand tu travailles avec des données client, cette caractéristique change tout. Tu maîtrises où sont tes documents, tu ne dépends d'aucun service tiers pour y accéder, et tu peux choisir librement ta stratégie de synchronisation et de sauvegarde (iCloud, Git, Obsidian Sync, Syncthing, ce que tu veux).

Architecture modulaire. Un vault par projet, par client, par domaine. Chaque vault est indépendant, avec sa propre arborescence et ses propres conventions. C'est cohérent avec une logique de knowledge base structurée — sujet sur lequel je reviendrai dans un article dédié.

Un écosystème de plugins très riche qui permet à l'outil d'évoluer avec les pratiques. La communauté Obsidian est l'une des plus actives qui soient, et elle produit des plugins pour à peu près tous les besoins, y compris l'intégration directe avec les LLM.

Les fonctionnalités d'Obsidian qui servent un projet IA

Sans entrer dans le détail technique, voici les fonctionnalités qui font la différence dans un projet IA bien structuré.

Le graph view et les liens internes matérialisent visuellement les connexions entre les documents de ton projet. Tu écris [[nom-du-fichier]] dans une note, et Obsidian crée automatiquement un lien navigable. Au fil du temps, ton vault devient un réseau de connaissances explorable, dans lequel les relations entre concepts deviennent aussi importantes que les contenus eux-mêmes. Précieux pour une knowledge base de projet.

Le système de tags et de propriétés structure la donnée au-delà du simple texte. Tu tagues tes notes (#audit, #prompt-validé, #en-cours), tu utilises le frontmatter YAML pour y associer des métadonnées, et tu peux ensuite filtrer, requêter, organiser ta base documentaire avec une finesse qu'aucun système de dossiers ne permet.

Les templates te permettent de standardiser les formats récurrents : un template de brief, un template d'audit, un template de fiche client, un template de prompt validé. À chaque nouveau document, tu pars d'une structure éprouvée. C'est une mécanique simple, mais qui fait gagner un temps considérable et garantit la cohérence éditoriale du vault.

Les plugins IA méritent une mention rapide. Des plugins comme Smart Connections, Copilot ou d'autres connectent directement Obsidian aux LLM, et permettent d'exploiter ton vault comme une knowledge base interrogeable par l'IA. Le sujet est riche, et il dépasse le cadre de cet article — j'y reviendrai si la demande est là.

L'export vers PDF est natif, et des plugins permettent de convertir vers d'autres formats au besoin. La sortie de tes livrables est donc fluide.

Un futur article dédié à Obsidian est envisagé, pour creuser concrètement comment je l'utilise sur mes projets clients.

Conclusion

Le choix de Markdown n'est pas un détail technique. C'est une décision structurante qui aligne ta méthode de travail avec le format dans lequel l'IA évolue nativement. Tu n'écris plus dans un format que l'IA doit interpréter avec plus ou moins de bonheur — tu écris dans le format qu'elle parle déjà, et toute la chaîne de production en bénéficie.

Adopté de manière disciplinée, Markdown devient bien plus qu'un format de fichier. C'est un actif de méthode : il structure ta knowledge base, il sert de matrice à tes livrables, il fluidifie ta collaboration avec les LLM, et il garantit que ton travail reste lisible, portable et maintenable dans la durée.

Bien outillé — Obsidian en tête — il devient un véritable environnement de production, pensé pour la décennie qui s'ouvre. Et c'est précisément cette continuité entre format, méthode et outil qui fait la différence entre une production IA improvisée et une pratique professionnelle solide.